技术预见通讯2008年第11期(总第178期)

不久的将来,随着高清晰数字摄像设备大大普及,视频信息的获取将变得更为容易,人们可以更加简洁轻松地使用DV、摄像头和手机等获得数字视频。同时随着数字媒体应用的深入,也将大大增加数字特效应用的需求,使得动画和视频交互处理的应用日益普及。这两方面发展,将大大促进媒体融合的增强现实技术发展。

一、媒体融合的增强现实技术发展前瞻

1、沉浸式数字娱乐

(1)沉浸式电影

将来的电影将以数字电影为主,数字电影将实拍和电脑制作相结合,后期处理采用数字中间片技术。随着数字电影快速发展,预计不久的将来使基于实时视频融合技术的“沉浸式电影”成为可能情况。

应用实时视频合成技术的“沉浸式电影”,将观众身体的某个部位(通常指脸部)实时合成到某主角对应的身体部位,进而产生沉浸式的感觉,电影观众以“参与模式”就可以观看到自己主演的电影。

以下是沉浸式电影的应用举例。某个周末,A先生去电影院观看电影。A先生走到放映厅门口,一边将电影票交给工作人员,一边走过红外线人体扫描仪。工作人员同时将票根上的编号和座位号码,以及人体扫描资料输入到放映设备中。此时电影院正在播放《功夫》。观众A坐到自己的位置在座位手把操控设备上点击“参与模式”,A先生的五官被实时地贴到男主角周星驰的脸上。A先生在自己的座位上欣赏了自己担任主角的电影。当电影结束时,A先生还深深地沉浸在电影的高潮跌宕的剧情中。A先生看完电影回到家里,打开电脑,拿出电影票的票根,输入电影票的编号,便可以下载由自己主演的电影《功夫》。于是A先生将这部由自己主演的电影上传到了电视博客上,供朋友在线观看。

(2)沉浸式卡拉OK

实时视频融合技术可以类似应用于“沉浸式卡拉OK”,视频融合系统将卡拉OK表演者的表情和动作实时融合到卡拉OK的舞台场景中,这样普通的卡拉OK爱好者将虚拟地实现在香港红磡体育馆表演的愿望。

(3)沉浸式游戏

“沉浸式游戏”将是将来的网络游戏重要卖点,网络游戏引擎将实时融合通过摄像头获取的玩家脸部信息,这样玩家在游戏中扮演的是具有自己脸部表情的游戏角色,使游戏玩家获得更加强烈的角色沉浸感。

2、三维真实感网络购物

随着实时视频融合技术发展,将来的网络购物将更加个性化。“三维真实感网络购物”即网络上产品的展示将是三维的立体商品,用户可以通过鼠标的转动,在360度方向上观看产品的外观。像类似于冰箱等允许查看内部结构的商品,用户还可以通过鼠标查看三维商品的内部结构,使商品选择更加直观。

以下是“三维真实感网络购物”的应用举例。某个周末网上购物爱好者B先生想购买新式太阳镜。B先生打开电脑,登录某网上购物站点,找到太阳镜商品列表,并且选中新推出的某品牌太阳镜。于是B先生转动着鼠标在各个角度上来欣赏此太阳镜。然后B先生点击网站提供的“虚拟佩戴模式”按钮,B先生的脸部三维信息立刻通过网络传递到网站服务器,并且通过视频快速实时融合技术,将佩戴了此太阳镜的B先生的脸部三维信息迅速反馈在屏幕上。B先生再次转动鼠标确认佩戴的效果,最后点击购买。第2天后此太阳镜就送到了B先生的手中。真是直观、快捷和方便。

二、国外发展趋势分析

就国家发展趋势来看,增强现实技术已经发展到媒体融合阶段,但是未到成熟状况。

1、增强现实技术已经发展到媒体融合阶段

增强现实(AugmentedReality,简称AR)是近年来国外众多的知名大学和研究机构的研究热点之一。增强现实借助计算机图形技术和可视化技术形成在现实环境中不存在的虚拟对象,通过传感技术将虚拟对象准确“放置”在真实环境中,借助显示设备将虚拟对象与真实环境融为一体,并且呈现给使用者在感官上的效果真实的新环境。美国“巴特尔研究所”在研究报告中列出10个2020年最具战略意义的技术趋势,这些趋势将决定着将来某个时期的社会发展特征,其中排名第10位的便是增强现实技术。AR技术除了应用于与虚拟现实技术(VR)相类似的应用领域(诸如飞行器的研制与开发、数据模型的可视化、虚拟训练、娱乐与艺术等领域)外,更由于其具有能对真实环境进行增强显示输出的特性,更广泛被应用于医疗研究与解剖训练、精密仪器制造和维修、工程设计和远程机器人控制等领域。为获得沉浸感的虚拟环境显示,增强现实应用系统通常采用头盔显示系统或空间投影显示系统。前者能实现完全沉浸式的虚拟环境显示,后者支持多用户共享的虚拟环境显示。

(1)一般增强现实技术

一般增强现实技术为使用者再现了三维真实环境,使用者无须身临其境就可以获得几乎真实的环境感受。一般增强现实技术主要依赖于真实环境数据的收集和计算机建模。此技术目前已经应用于数字化文化遗产保护和教育等领域。例如,文化古迹的信息可以通过增强现实的方式提供给参观者,用户不仅能看到古迹的文字解说,而且还能看到遗址残缺部分的虚拟重构。

(2)动态增强现实技术

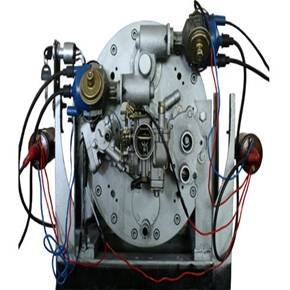

动态增强现实技术是在一般增强现实的基础上增加了互动和动态跟踪功能。根据使用者的需求,将真实物体与增强现实环境进行叠加,或者帮助使用者直接参与增强现实环境所体现的真实环境的相关工作。例如:在工业维修领域中,用户可以通过头盔式显示器获得多种辅助信息显示,包括虚拟仪表面板、被维修设备内部结构和被维修设备零件图等,用户还可以通过机械手操作对被维修设备进行修复,而机械手的操作结果也可以通过增强现实技术反馈到头盔式显示器上;在医疗领域中,医生可以应用增强现实技术,轻易地进行手术部位的精确定位和操作。

在手机娱乐方面,西门子已经推出“虚拟足球”(KickReal)游戏。玩家用摄像头对着脚,就可以踢动画面上的足球,进行射门练习。奥地利的大学生DanielWagner设计了运行在i-mateSP5WindowsMobilePhone上的增强虚拟现实技术演示Demo,可以将虚拟的角色跟现实背景完美的融合起来,更能随着手机角度和位置的变化显示合适的图像。

虚拟演播室是典型的增强现实系统。虚拟演播室能跟踪摄像机的运动,根据摄像机当前的方位实时渲染出虚拟环境,并且应用色键技术把主持人与虚拟环境合成起来,以使观众形成主持人位于某一虚拟环境的视觉感受。虚拟演播室目前已经得到了成功的应用。

(3)媒体融合增强现实技术

媒体融合增强现实技术在动态增强现实的基础上又增加了视频目标跟踪和实时融合功能。此技术帮助使用者能锁定在增强现实环境中的已经有的目标,并且将真实环境的物体影射到此目标上,替代其参与增强现实环境中的运动,同时根据真实环境物体的特点进行相应的调节。例如,沉浸式电影、沉浸卡拉OK等。

又如,让已故的明星再次参与新片的制作,与活生生的演员同时出场。韩国和日本曾计划拍摄《纹龙斗士》,由数码合成的“李小龙”担当主角。通过媒体融合增强现实技术,就可以让替身演员演完全部影片后,再由电脑将已故明星取代替身演员,免去完全数码合成的过程。

再如,在电视直播过程中的角色替代。在电视直播中,有时会出现突发事件,在目前的技术条件下,一般采用录播或暂停直播的方式补救。而通过媒体融合增强现实技术,就可以通过将指定目标替代在真实场景和过程中需要替换的部分,继续直播过程,这比录播更具有真实性,此应用包含了视频和音频融合等多项媒体融合技术。

2、媒体融合的增强现实技术仍未成熟

计算机图形学的先驱伊凡?苏泽兰特(IvanSutherland)和他的学生20世纪60年代共同开发了第1个增强现实的原型系统。20世纪70年代到20世纪80年代,在诸如NASA的Ames研究中心和北卡罗来纳大学等研究机构中,研究人员进行了增强现实方面的研究。20世纪90年代初,波音公司的科学家们才在其研究中正式提出了“增强现实”术语。在近些年来年中,由于硬件成本大大降低,新成立了许多实验室,增强现实领域的研究呈现出了百花齐放的局面。1998年开始起,科学家们每年都举行有关增强现实技术的学术会议。

动态增强现实技术目前已经较为成熟,并且被应用于相关领域。国外研究AR系统的机构有德国SIEMENSAG、美国哥伦比亚大学、澳大利亚Vienna大学和日本Nara协会等,这些机构已经在AR系统的摄像机校正算法、AR头盔显示器的设计、硬件平台的应用和视觉跟踪技术等方面取得了一定的成果。新近公开的德国专利DE10108064述及的增强现实系统,用视频或音频信息进行综合视觉跟踪,系统由以下部分组成:目标跟踪系统,探测信息,并且报告其位置;图像记录单元,记录图像,并且转换格式;注释系统,合成位置数据,存档数据。同年公开的美国专利US2002191003涉及到的增强现实显示技术,用摄像机定位物体位置,并且报告给连通的计算机,以呈现图像。这种方法可以呈现出天气和险情等情况,通过计算机图像处理后得到的画面令观众身临其境,其主要应用包括航海安全控制辅助、飞行员培训和应急训练等。

媒体融合的增强现实技术还在发展中,在目前仅有相关技术应用的讨论和小范围应用。例如,其关键技术之一的动态视频目标跟踪技术已经被应用于智能化视频监控技术,智能化视频监控技术提供有效的目标自动跟踪的工具,在用计算机自动处理视频流的过程中,发现和跟踪感兴趣的目标,并且可以控制移动摄像机,对目标实现自动跟踪。虚拟现实与增强现实目前通常需要比较昂贵的设备,此外算法的实时性也往往满足不了应用的需要,因此,虚拟场景与现实视频的无缝融合,以及在通用设备上的实时运行,仍然是研究的热点与难点。

在将来数字媒体的某些应用中,例如,在数字影视和网络游戏中,往往需要将真实拍摄的视频和特定的数字场景实时、高效融合起来,以增强身临其境的感受和娱乐体验,基于实时视频融合的增强现实技术将大量应用在日常生活中。因此,基于动态视频合成与交互的增强现实研究已经成为计算机视觉和计算机图形学等相关领域迫切需要进行的研究课题。

◇以上内容仅供参考